Open Data et nettoyage de données…

Attention: cet article date du 29 janvier 2020

Ce qu'il contient est peut être encore valable...

... ou complètement obsolète!

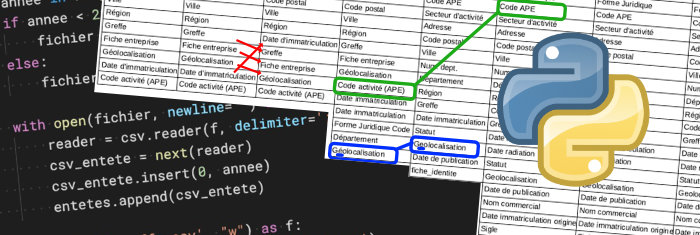

Préparant activement un cours de python dans un cadre de data science, je m’intéresse aujourd’hui à la récupération de données.

Pour ce faire, l’OpenData est un sacré fournisseur: gratuité, variété, quantité, qualité et pérennité…

Mais… je viens d’écrire qualité et pérennité? Affinons un peu.

Important

Initialement publié sur ce site le 29 janvier 2020, j’ai l’ai déplacé sur un nouveau site dédié aux données, Datas.fun.